Symposium ‘De terugkeer van de burger in de rechtsstaat’

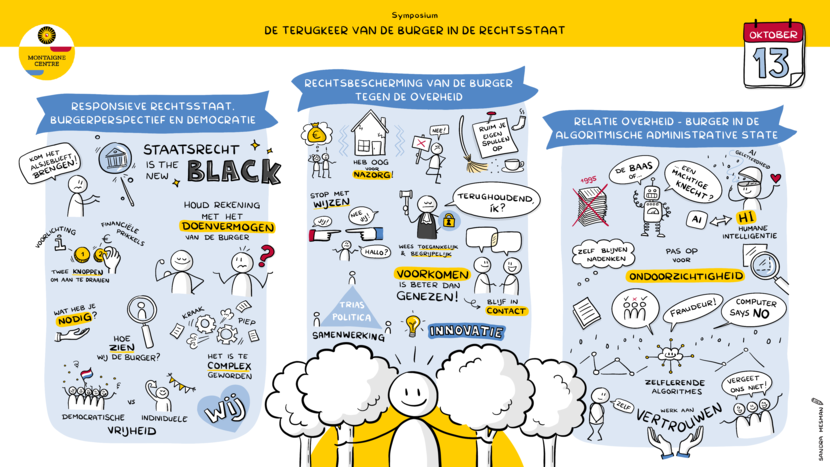

Vrijdag 13 oktober spraken drie commissieleden tijdens het symposium ‘De terugkeer van de burger in de rechtsstaat’, bij de Universiteit Utrecht. Na het symposium sprak hoogleraar Jurgen Goossens zijn oratie uit over ‘De terugkeer van het staatsrecht’. Bij het symposium waren mensen aanwezig uit de wetenschap, de rechterlijke macht en de praktijk. Voor de Staatscommissie rechtsstaat was deze bijeenkomst daarom een mooie gelegenheid om informatie uit te wisselen.

De Staatscommissie rechtsstaat wil graag actuele ervaringen en inzichten gebruiken in het onderzoek en de voorstellen voor het verbeteren van de rechtsstaat. Zo vertelde de Groningse hoogleraar Bert Marseille dat een derde van bezwaarprocedures berust op een misverstand. Deze kunnen makkelijk opgelost worden door contact te zoeken met de burger.

Burger van bordkarton

De staatscommissie zelf heeft meegewerkt aan het thema over wat de burger mag verwachten van de overheid. Zo noemde commissielid Marc Hertogh het voorbeeld van een ouder echtpaar uit Groningen wiens huis was beschadigd vanwege gaswinning. Hij beschreef hoe er weliswaar juridisch niets mis was met de manier waarop hun zaak pas na vele jaren werd afgehandeld, maar dat er op het persoonlijk en menselijk vlak nog heel veel te winnen viel. ‘Van de rechtsstaat komt niets terecht als je de gevolgen voor mensen niet meeneemt’, legde hij uit. Na jaren kreeg het echtpaar alsnog een schadevergoeding toegekend.

Hertogh vertelde hoe de burger nu geen rol heeft in de trias politica, terwijl dit wel het geval zou moeten zijn. ‘We reageren nu op een burger van bordkarton’, legde hij uit. Hij pleit voor een minder ‘kille’ rechtsstaat, en voor een responsieve rechtsstaat, waarin er aandacht is voor het effect van het recht voor burgers.

Artificial intelligence

Commissielid Fatma Çapkurt sprak over de risico’s van artificial intelligence (AI), zoals negatieve vooringenomenheid in algoritmes. AI kan weliswaar helpen om digitale systemen beter te laten functioneren, maar daarbij moet er meer aandacht zijn voor de bescherming van de burger. Er moet daarom een vorm van transparantie en menselijke correctie zijn. Maar, legde Çapkurt uit, een menselijke controle alleen is niet genoeg, want overheidsmedewerkers zijn geneigd om uit te gaan wat een algoritme of AI hen vertelt, daarmee staat het zelf kritisch na denken al direct op een 3-0 achterstand. Juist waar het systeem knellend is voor afhankelijke burgers is dat een risico. Daarom pleit zij voor ‘AI-geletterdheid’, zodat zowel burgers als staatsmachten beter om leren gaan met de aanwezigheid van AI in de rechtsstaat. Oud-minister Ernst Hirsch Ballin nuanceerde het deel ‘intelligence’: gaat het wel om ‘intelligentie’ en moeten we human intelligence niet meer op de voorgrond zetten?

Staatscommissie rechtsstaat

Voorzitter Henk Kummeling sloot het symposium af met een slotbeschouwing over de besproken thema’s, die ook terugkomen in het onderzoek waarmee de staatscommissie hard bezig is. Ook de inzichten uit de wetenschap worden gebruikt in de concrete maatregelen van de staatscommissie (juni 2024), waardoor de rechtsstaat beter moet functioneren voor de burger.

|

Een derde van de bezwaarprocedures berust op een misverstand. Goed contact met burgers kan dit helpen voorkomen. De overheid mag niet van burgers verwachten dat zij zelf de overheid opzoeken. Het contact tussen burger en overheid verloopt beter wanneer overheidsmedewerkers uit hun ‘beleidsbubbel’ stappen, in plaats van burgers die bubbel in te trekken. De looptijd voor een bestuursrechtelijke zaak is erg lang. Die tijd moet korter, maar in afwachting van een rechtszaak kunnen burger en overheid alvast gezamenlijk proberen hun probleem op te lossen. Zeker wanneer rechtbanken vragen om mediation tussen deze partijen. Het handelen van de overheid is vaak gebaseerd op een verkeerd beeld van de burger. Zo wordt het ‘doenvermogen’ van de burger vaak overschat, bijvoorbeeld bij het aanvragen van toeslagen. Het helpt wanneer het handelen van de overheid concreet zo wordt ingericht dat het mensen helpt. Bijvoorbeeld door het automatisch stopzetten van een ov-kaart nadat studenten afstuderen, in plaats van die verantwoordelijkheid bij henzelf neer te leggen. Wanneer een persoon gebruikmaakt van algoritmes of artificial intelligence in het werk, heeft dit als psychologisch bijeffect dat wat deze AI of algoritme zegt, sneller als waarheid wordt gezien. Alleen menselijke controle op kunstmatige intelligentie is dus niet voldoende om misstanden te voorkomen. Daarom moet er binnen alle staatsmachten AI-geletterdheid ontwikkeld worden. |